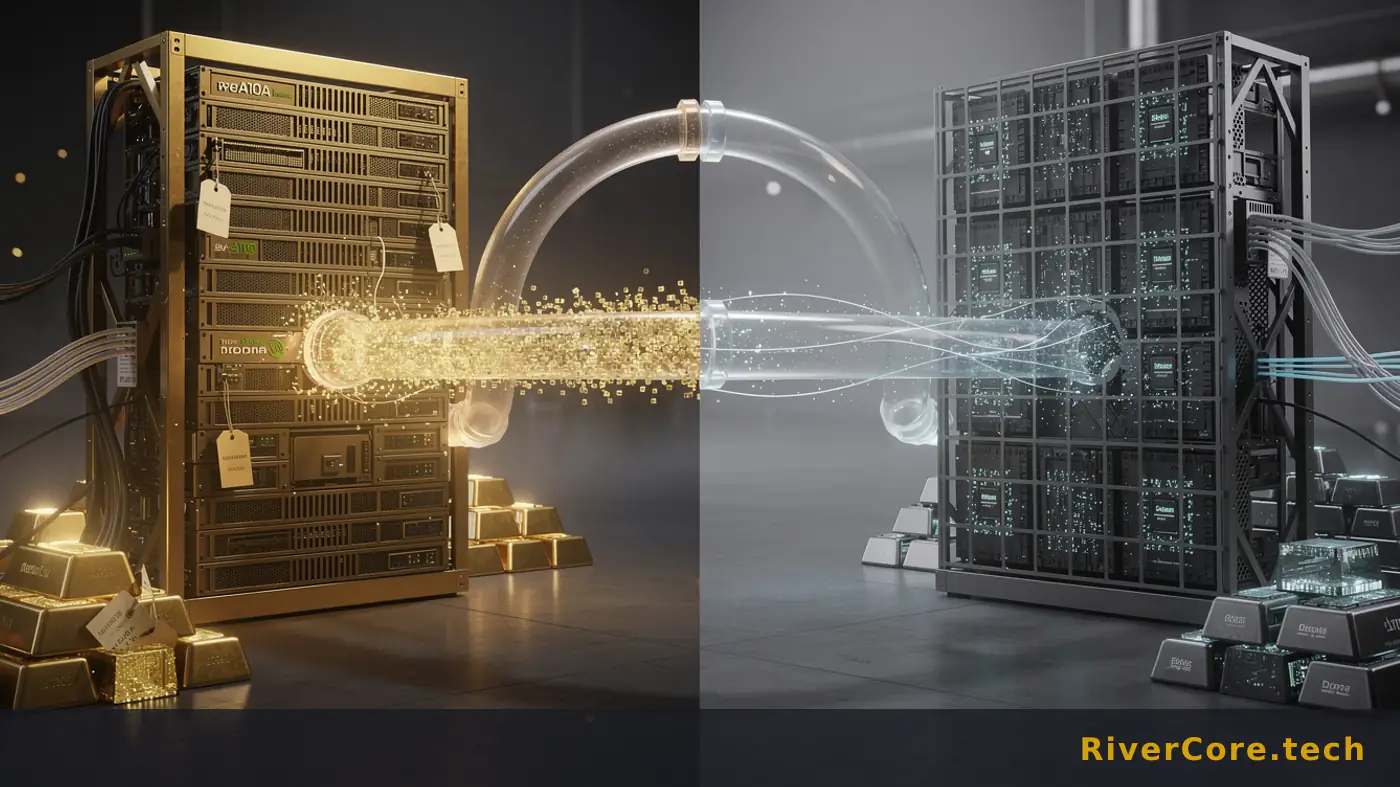

Moreh erreicht A100-Werte auf Tenstorrent – ohne HBM-Aufpreis

Stellen Sie sich einen Rangierbahnhof vor, auf dem seit einem Jahrzehnt jeder Container auf demselben Gleis fährt. Dann taucht jemand mit einem zweiten Gleis auf – schmaler, günstiger – und weist darauf hin, dass die Hälfte der Fracht gar nicht die Schnellstrecke braucht. Genau das hat Moreh gerade auf einer Bühne in San Francisco demonstriert, nur dass die Fracht aus LLM-Tokens besteht und die Schnellstrecke aus HBM-vollgepackten GPUs.

Was passiert ist

Am 1. Mai präsentierte das in Santa Clara ansässige Unternehmen Moreh beim TT-Deploy-Event von Tenstorrent in San Francisco eine Live-Demo zur LLM-Inferenz auf dem Tenstorrent Galaxy Wormhole-System. Wie 巴士的報 am Folgetag berichtete, erzielte das Unternehmen auf Galaxy Wormhole Inferenzwerte, die NVIDIA DGX A100-Systeme bei einer Reihe von Mixture-of-Experts-Modellen erreichen oder übertreffen: GPT-OSS, Qwen, GLM und DeepSeek.

Die Validierung basierte auf Morehʼs eigenem MoAI Inference Framework. Der zentrale Kniff ist architektonischer Natur, nicht siliziumbasiert: ein disaggregiertes Serving-Setup, das GPUs mit Tenstorrent Wormhole-Chips kombiniert und die Tenstorrent-Prozessoren als dedizierte Prefill-Beschleuniger einsetzt. Decode verbleibt auf den GPUs. Prefill wird ausgelagert. Das Ergebnis ist laut Moreh eine deutlich reduzierte Abhängigkeit von kostspieligem HBM und eine insgesamt niedrigere Infrastrukturrechnung.

CEO Gangwon Jo bezeichnete es als Meilenstein. „Das Erreichen produktionsreifer LLM-Inferenzleistung und -stabilität auf Tenstorrent-basierten Systemen ist ein bedeutender Meilenstein", sagte er und fügte hinzu, dass das Team „die Leistung durch tiefere Optimierung heterogener Architekturen und engere Integration mit Tenstorrent NPUs weiter verbessern wird".

Wichtiger Kontext: Moreh ist strategischer Partner von Tenstorrent und einer der wichtigsten externen Beitragenden zu Metalium, Tenstorrents Low-Level-Programmier-Stack. Das Unternehmen betreibt bereits AMD-GPU-basierte Produktionsumgebungen in echten Rechenzentren, hat ein Tochterunternehmen für Foundation-Modelle namens Motif Technologies und nennt Kooperationen mit AMD, Tenstorrent und SGLang. All das ist kein Zufall. Produktionsreife Zahlen auf neuartigen Chips erzielt man nicht ohne Jahre an fremdem Debugging, das in den eigenen Runtime eingeflossen ist.

Technische Analyse

Um zu verstehen, warum das relevant ist, muss man sich ansehen, was ein LLM bei einer Anfrage tatsächlich tut. Es gibt zwei Phasen, die so unterschiedliche Charaktere haben wie ein Sprinter und ein Marathonläufer. Prefill verarbeitet den gesamten Eingabe-Prompt parallel: compute-gebunden, problemlos parallelisierbar, hungrig nach FLOPs. Decode generiert Token für Token, autoregressiv, latenzsensitiv und durch die Speicherbandbreite gebremst – genau deshalb existiert HBM.

Die Standard-Antwort der Branche lautet: beide Phasen auf dieselbe GPU werfen und hoffen, dass die Batching-Strategie den Mismatch kaschiert. Wer jemals um 2 Uhr nachts ein vLLM-Deployment optimiert hat, kennt das langweilige Detail: Prefill-Spitzen ruinieren die Tail-Latenz, und HBM liegt während langer Decode-Phasen weitgehend ungenutzt. Man zahlt Premium-Preise für Speicher, um Rechenarbeit zu erledigen.

Disaggregiertes Serving trennt beides. Prefill geht an einen für Compute-Durchsatz optimierten Knoten, der KV-Cache wird an einen für Speicherbandbreite optimierten Decode-Knoten übergeben, und jedes System tut, was es am besten kann. Splitwise und DistServe haben den wissenschaftlichen Beweis erbracht. Morehʼs Beitrag ist die Produktionsverdrahtung auf heterogenem Silizium: Prefill auf Tenstorrent Wormhole, Decode auf GPUs, orchestriert von MoAI als einzelner Cluster.

Wormholes Profil passt gut in diesen Slot. Der Chip setzt auf eine SRAM-lastige Tile-Architektur statt auf HBM-Stacks – genau das, was man braucht, wenn die Aufgabe dichtes Matmul auf einem bekannten Prompt ist und kein riesiger KV-Cache gestreamt werden muss. Als Prefill-Beschleuniger eingesetzt, sinkt die HBM-Rechnung – der Teil, an dem alles finanziell auseinanderfällt –, weil HBM nur für die Decode-Flotte dimensioniert werden muss.

Das MoE-Detail ist ebenfalls wichtig. GPT-OSS, Qwen, GLM und DeepSeek leiten Tokens an Expert-Teilmengen weiter, was Kommunikations-Overhead hinzufügt, aber den Compute pro Token reduziert. MoE auf einem Nicht-NVIDIA-Backend korrekt zum Laufen zu bringen bedeutet, All-to-All-Routing über ein Fabric zu handhaben, das nicht für NCCL entwickelt wurde. Das ist der Kern der Sache – und dort zahlt sich der Beitrag zu offenen Inferenz-Stacks wie SGLang aus.

Wer unter Druck gerät

NVIDIAs Monokultur ist die offensichtliche Antwort, aber die tatsächliche Betroffenheit ist interessanter. Die Unternehmen, die wirklich schwitzen sollten, sind Inference-as-a-Service-Anbieter, die ihre Margen auf der Annahme kalkuliert haben, dass DGX-Klasse H100/H200-Flotten der einzige Weg zu produktionsreifer Latenz sind. Wenn ein koreanisches Software-Unternehmen durch cleveres Anfrage-Topology-Design A100-Zahlen auf günstigerem Silizium erreicht, beginnt der Boden unter Premium-GPU-Vermietungen zu wanken.

A100-Klasse ist nicht H200-Klasse, und ich würde argumentieren, dass Moreh diesen Vergleich bewusst sorgfältig wählt. Das Versprechen lautet nicht „wir schlagen die Frontier". Das Versprechen lautet „wir erreichen das Arbeitspferd-Niveau zu niedrigeren Materialkosten". Für 80 % der Enterprise-Inferenz-Workloads (RAG-Endpunkte, interne Copilots, Batch-Zusammenfassungen) ist A100-Klassen-Durchsatz zu niedrigeren Kosten der eigentliche Markt.

Die nächsten 90 Tage dürften für zwei spezifische Gruppen schmerzhaft werden. Erstens: Single-Vendor-GPU-Cloud-Startups, deren gesamter Burggraben aus „wir haben Zuteilung" besteht. Wenn heterogene Cluster bestellbar werden, hört Zuteilung auf, ein Burggraben zu sein. Zweitens: Infrastruktur-Teams bei mittelgroßen KI-Unternehmen, die ihren Stack mit der Annahme „CUDA für immer" aufgebaut haben. Ihre CTOs werden beginnen, Board-Fragen zur Hardware-Diversifizierung zu erhalten, und „wir laufen nur auf NVIDIA" wird eine immer schwerer zu verteidigende Antwort.

Tenstorrent selbst erhält eine echte Produktionsreferenz. Bis jetzt war das Versprechen rein theoretisch. TT-Deploy mit einer Live-Demo eines Partners, der echte MoE-Workloads betreibt, ist das erste Mal, dass das Unternehmen auf etwas jenseits von Benchmarks verweisen kann. AMD kommt gut weg: Morehʼs Framework unterstützt AMD-GPUs im selben Cluster, was bedeutet, dass MI300-Klasse-Hardware nun einen glaubwürdigen Inferenzpartner hat, der sie nicht gegen NVIDIA eintauschen will.

Empfehlungen für die KI-Entwicklung

Wer Inferenz in nennenswertem Umfang betreibt, hat diese Woche eine klare Hausaufgabe. Auditieren Sie Ihr Prefill-zu-Decode-Verhältnis. Wenn Sie nicht wissen, welcher Anteil Ihrer GPU-Sekunden auf Prefill gegenüber Decode entfällt, können Sie über Disaggregation nicht sinnvoll nachdenken – und kaufen mit hoher Wahrscheinlichkeit zu viel HBM. Die meisten Teams stellen fest, dass Prefill bei Long-Context-Workloads 30–50 % des Computes ausmacht, und das ist genau der Anteil, den man von Premium-Silizium wegverlagern kann.

Zweitens: Hören Sie auf, Vendor-Lock-in als theoretisches Problem zu behandeln. Das MoAI Inference Framework unterstützt NVIDIA, AMD und Tenstorrent in einem einzelnen Cluster. Unabhängig davon, ob Sie Moreh einsetzen oder nicht – gestalten Sie Ihren Serving-Layer so, dass ein Backend-Wechsel eine Konfigurationsänderung ist, kein Rewrite. SGLang und ähnliche Runtimes bieten dafür eine vernünftige Abstraktion. Nutzen Sie sie.

Drittens: Wenn Sie ein agentisches Produkt entwickeln, prüfen Sie, wo Prefill Ihre Rechnung dominiert. Tool-calling-Agenten, die bei jedem Schritt lange Context-Fenster neu prefill-en, sind der schlimmste Fall für monolithisches GPU-Serving. Die in den Anthropic-Docs beschriebenen Muster zu Prompt-Caching und Tool-Nutzung helfen nur begrenzt weiter. Die strukturelle Lösung ist Disaggregation – und sie ist jetzt kaufbar.

Viertens: Sprechen Sie mit dem Einkauf. Lieferzeiten für Tenstorrent Galaxy-Systeme sind nicht mit H200-Lieferzeiten vergleichbar. Wenn Ihr Kapazitätsplan für 2026 lautet „auf NVIDIA-Zuteilung warten", gibt es jetzt einen glaubwürdigen parallelen Weg. Rechnen Sie die Zahlen für einen gemischten Cluster durch, bevor Ihr nächster Budgetzyklus beginnt.

Die wichtigsten Erkenntnisse

- Morehʼs MoAI Inference Framework erreichte DGX A100-Klasse-Werte auf Tenstorrent Galaxy Wormhole für die MoE-Modelle GPT-OSS, Qwen, GLM und DeepSeek – live validiert bei TT-Deploy am 1. Mai.

- Die Architektur verlagert Prefill auf Tenstorrent und behält Decode auf GPUs, was die HBM-Abhängigkeit und die Gesamtinfrastrukturkosten senkt.

- MoAI betreibt NVIDIA-, AMD- und Tenstorrent-Silizium in einem einzelnen Cluster – die erste produktionsreife Antwort auf Vendor-Lock-in, die ich tatsächlich vorgeführt und nicht nur als Foliensatz gesehen habe.

- Das Risiko betrifft Single-Vendor-GPU-Clouds und reine CUDA-Inferenz-Stacks, nicht NVIDIAs Frontier-Silizium, das an der Spitze weiterhin unangefochten ist.

- Auditieren Sie diese Woche Ihr Prefill-zu-Decode-Verhältnis und gestalten Sie Ihren Serving-Layer so, dass Backend-Wechsel auf Konfigurationsebene stattfinden, nicht auf Architekturebene.

Zurück zum Rangierbahnhof. Die Schnellstrecke läuft noch, die H200s gehen nirgendwohin, und Frontier-Training bleibt auf absehbare Zeit eine CUDA-Geschichte. Aber das zweite Gleis ist in Betrieb, und die Fracht, die die Schnellverbindung nicht braucht, hat jetzt eine günstigere Option. Das ist der Teil, den die Hyperscaler zuerst bemerken werden – und um den wir anderen planen sollten.

Häufig gestellte Fragen

F: Was ist disaggregiertes LLM-Serving und warum ist es wichtig?

Disaggregiertes Serving trennt die zwei Phasen der LLM-Inferenz – Prefill (Verarbeitung des Eingabe-Prompts) und Decode (Token-Generierung) – auf separate, jeweils dafür optimierte Hardware. Prefill ist compute-gebunden, Decode ist speicherbandbreitengebunden. Beide auf derselben GPU zu betreiben, verschwendet Ressourcen. Die Trennung ermöglicht es, jede Flotte unabhängig zu dimensionieren und günstigeres Silizium für Prefill einzusetzen.

F: Bedeutet das, dass Tenstorrent mit NVIDIAs Flaggschiff-Chips H100 oder H200 mithalten kann?

Nein. Morehʼs Aussage bezieht sich auf das Erreichen oder Übertreffen von DGX A100-Klasse-Leistung – das ist NVIDIAs Arbeitspferd der Vorgängergeneration, nicht die aktuelle H100/H200-Frontier. Das Versprechen ist kosteneffiziente Parität auf Enterprise-Inferenz-Niveau, nicht die Verdrängung von Top-End-Training-Silizium.

F: Können Teams das MoAI Inference Framework heute auf gemischter Hardware einsetzen?

Laut Moreh unterstützt MoAI den einheitlichen Betrieb von NVIDIA-, AMD- und Tenstorrent-Prozessoren innerhalb eines einzelnen Clusters. Das Unternehmen ist strategischer Partner von Tenstorrent und maßgeblicher Contributor zu Metalium. Die Produktionsreife auf Tenstorrent wurde am 1. Mai 2026 bei TT-Deploy validiert. Die Einführungszeiträume für externe Teams hängen von der direkten Zusammenarbeit mit Moreh ab.

Die Claude Code-Geschichte, die wir noch nicht verifizieren können

Die einzige verfügbare Quelle zu Claude Code ist eine Browser-Verifizierungsseite – null verwertbare Fakten. Was diese Abwesenheit für KI-Käufer bedeutet.

Die Anthropic-vs-OpenAI-Umsatzgeschichte, die wir noch nicht verifizieren können

Eine Schlagzeile behauptet, Anthropic überholt OpenAI beim LLM-Umsatzanteil – doch die zugrunde liegende Quelle steckt hinter einer Browser-Verifikationsseite. Was das bedeutet.

X baut Ad-Stack auf xAI um: 2,46 Mrd. $ Ziel für 2026

X hat eine neu aufgebaute Werbeplattform auf Basis von xAI-Rankingmodellen gestartet und verfolgt eMarketers Prognose von 2,46 Mrd. $ für 2026 – ein Plus von 8,8 % gegenüber 2025 in einem von Google und Meta dominierten Markt.