Moreh достигает показателей A100 на Tenstorrent без HBM-налога

Представьте грузовой двор, где все вагоны десять лет ходят по одной колее. И вдруг кто-то прокладывает второй путь — уже, дешевле — и замечает, что половина груза вовсе не нуждается в экспрессе. Примерно это только что сделала Moreh на сцене в Сан-Франциско, только вместо груза — токены LLM, а вместо экспресса — GPU с HBM.

Что произошло

1 мая на мероприятии Tenstorrent TT-Deploy в Сан-Франциско компания Moreh из Санта-Клары вышла на сцену и запустила живое демо инференса LLM на системе Tenstorrent Galaxy Wormhole. Как сообщило издание 巴士的報 на следующий день, компания заявила о показателях инференса на Galaxy Wormhole, сопоставимых или превосходящих системы NVIDIA DGX A100 на наборе моделей Mixture-of-Experts: GPT-OSS, Qwen, GLM и DeepSeek.

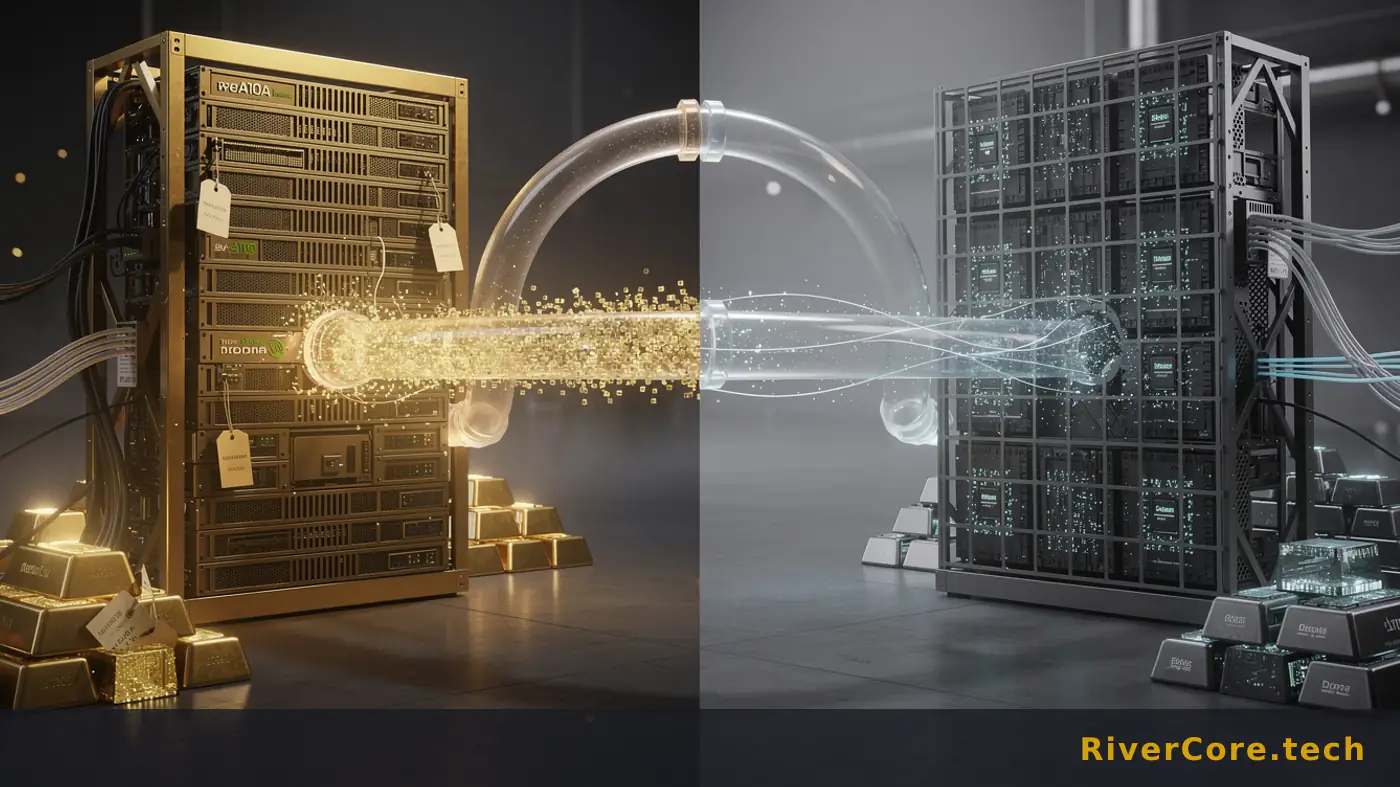

Валидация была проведена с использованием собственного фреймворка MoAI Inference Framework от Moreh. Ключевая особенность — архитектурная, а не кремниевая: дезагрегированная конфигурация, сочетающая GPU с чипами Tenstorrent Wormhole, где процессоры Tenstorrent используются как выделенные ускорители prefill. Decode остаётся на GPU. Prefill с них снимается. Результат, по данным Moreh, — существенное снижение зависимости от дорогостоящей HBM и уменьшение общих инфраструктурных затрат.

Генеральный директор Кангвон Джо назвал это важной вехой. «Достижение производственного уровня производительности и стабильности инференса LLM на системах Tenstorrent — значимый рубеж», — заявил он, добавив, что команда будет «продолжать повышать производительность за счёт более глубокой оптимизации гетерогенных архитектур и более тесной интеграции с NPU Tenstorrent».

Важный контекст: Moreh является стратегическим партнёром Tenstorrent и крупным внешним контрибьютором Metalium — низкоуровневого программного стека Tenstorrent. Компания уже эксплуатирует производственные среды на GPU AMD в реальных дата-центрах, имеет дочернее предприятие по foundation-моделям Motif Technologies и сотрудничает с AMD, Tenstorrent и SGLang. Всё это неслучайно. Производственные показатели на новом кремнии не появляются без многолетней отладки чужого кода, встроенной в ваш рантайм.

Техническая анатомия

Чтобы понять, почему это важно, нужно разобраться, что LLM делает с запросом. Есть две фазы, и они по характеру столь же разные, как спринтер и марафонец. Prefill обрабатывает весь входной промпт параллельно: compute-bound, идеально параллелизуемый, требует FLOPs. Decode генерирует токены по одному, авторегрессионно, чувствителен к задержкам и ограничен пропускной способностью памяти — именно поэтому HBM и существует.

Стандартный отраслевой ответ таков: бросить обе фазы на один GPU и надеяться, что стратегия батчинга скроет несоответствие. Любой, кто в 2 часа ночи настраивал деплой vLLM, знает скучную часть: пики prefill уничтожают хвостовые задержки, а HBM простаивает на длинных хвостах decode. Вы платите по ценам премиальной памяти за вычислительную работу.

Дезагрегированный serving разделяет их. Prefill отправляется на узел, оптимизированный под вычислительную пропускную способность, KV cache передаётся decode-узлу, оптимизированному под пропускную способность памяти, и каждый делает то, в чём силён. Splitwise и DistServe доказали это академически. Вклад Moreh — производственная обвязка на гетерогенном кремнии: prefill на Tenstorrent Wormhole, decode на GPU, всё управляется MoAI как единым кластером.

Архитектура Wormhole хорошо вписывается в эту нишу. Чип опирается на SRAM-heavy тайловую архитектуру, а не на стопки HBM — именно то, что нужно при плотных matmul на известном промпте без необходимости стримить огромный KV cache. Используйте его как ускоритель prefill, и затраты на HBM — та часть, где всё рушится финансово, — снижаются, потому что HBM вы размечаете только под decode-флот.

Деталь с MoE тоже важна. GPT-OSS, Qwen, GLM и DeepSeek маршрутизируют токены к подмножествам экспертов, что добавляет накладные расходы на коммуникацию, но снижает вычисления на токен. Правильная работа с MoE на не-NVIDIA бэкенде означает обработку all-to-all маршрутизации по фабрике, не предназначенной для NCCL. Вот в чём суть, и именно здесь окупается вклад в открытые инференс-стеки наподобие SGLang.

Кому это грозит

Монокультура NVIDIA — очевидный ответ, но реальная уязвимость интереснее. Беспокоиться должны провайдеры inference-as-a-service, которые закладывали маржу исходя из допущения, что парки DGX-класса H100/H200 — единственный путь к производственным задержкам. Если корейский программный стартап может достичь показателей уровня A100 на более дешёвом кремнии, грамотно выстроив топологию запросов, почва под премиальной арендой GPU начинает уходить.

A100-класс — это не H200-класс, и, на мой взгляд, Moreh намеренно осторожен в этом сравнении. Питч не «мы обогнали фронтир». Питч: «мы достигли рабочего уровня при меньших затратах на материалы». Для 80% корпоративных инференс-нагрузок (RAG-эндпоинты, внутренние копайлоты, пакетная суммаризация) пропускная способность уровня A100 при меньшей стоимости — это и есть реальный рынок.

Ближайшие 90 дней будут болезненными для двух конкретных групп. Первая — облачные GPU-стартапы с одним вендором, чей единственный ров — «у нас есть аллокация». Если гетерогенные кластеры станут заказываемыми, аллокация перестаёт быть рвом. Вторая — инфраструктурные команды AI-компаний среднего уровня, построившие свой стек в расчёте на вечный CUDA. Их CTO начнут получать вопросы от совета директоров о диверсификации железа, а «мы работаем только на NVIDIA» становится всё труднее отстаивать.

Tenstorrent получает реальный производственный референс. До сих пор питч строился на потенциале. TT-Deploy с живым демо от партнёра, запускающего реальные MoE-нагрузки, — первый случай, когда компании есть на что указать за пределами бенчмарков. AMD выходит из этого в плюсе: фреймворк Moreh поддерживает GPU AMD в том же кластере, а значит, железо уровня MI300 теперь имеет достоверного инференс-партнёра, не переходящего на сторону NVIDIA.

Руководство по AI-разработке

Если вы запускаете инференс в значимом масштабе, домашнее задание на эту неделю очевидно. Проведите аудит соотношения prefill и decode. Если вы не знаете, какая доля GPU-секунд уходит на prefill, а не на decode, вы не можете рассуждать о дезагрегации — и почти наверняка переплачиваете за HBM. Большинство команд обнаруживает, что prefill составляет 30–50% вычислений на длинноконтекстных нагрузках, и именно этот срез можно вывести с премиального кремния.

Второе: перестаньте считать vendor lock-in теоретической проблемой. MoAI Inference Framework поддерживает NVIDIA, AMD и Tenstorrent в едином кластере. Независимо от того, используете вы Moreh или нет, проектируйте слой serving так, чтобы смена бэкенда была изменением конфигурации, а не переписыванием. SGLang и аналогичные рантаймы дают разумную абстракцию. Используйте её.

Третье: если вы строите агентный продукт, посмотрите, где prefill доминирует в счёте. Агенты с вызовом инструментов, повторно выполняющие prefill длинных контекстных окон при каждом шаге, — наихудшая нагрузка для монолитного GPU-сервинга. Паттерны из документации Anthropic по кэшированию промптов и работе с инструментами помогают лишь до определённой степени. Структурное решение — дезагрегация, и теперь её можно купить.

Четвёртое: поговорите с отделом закупок. Сроки поставки систем Tenstorrent Galaxy — не то же самое, что сроки поставки H200. Если ваш план мощностей на 2026 год — «ждать аллокацию NVIDIA», теперь есть реальный параллельный путь. Просчитайте цифры по смешанному кластеру до следующего бюджетного цикла.

Ключевые выводы

- MoAI Inference Framework от Moreh достиг показателей DGX A100-класса на Tenstorrent Galaxy Wormhole на моделях MoE GPT-OSS, Qwen, GLM и DeepSeek — подтверждено вживую на TT-Deploy 1 мая.

- Архитектура переносит prefill на Tenstorrent, оставляя decode на GPU, что снижает зависимость от HBM и общие инфраструктурные затраты.

- MoAI запускает кремний NVIDIA, AMD и Tenstorrent в едином кластере — это первый производственный ответ на vendor lock-in, который я видел задемонстрированным вживую, а не на слайдах.

- Риски несут однонедорные GPU-облака и инференс-стеки только на CUDA — но не фронтирный кремний NVIDIA, который по-прежнему безоговорочно лидирует на верхнем уровне.

- Проведите аудит соотношения prefill и decode на этой неделе и спроектируйте слой serving так, чтобы замена бэкенда была на уровне конфигурации, а не архитектуры.

Возвращаясь к грузовому двору. Экспресс по-прежнему ходит, H200 никуда не денутся, и фронтирное обучение в обозримом будущем остаётся историей CUDA. Но второй путь открыт для бизнеса, и груз, которому экспресс не нужен, теперь получил более дешёвый вариант. Именно это гиперскейлеры заметят первыми, и именно вокруг этого нам всем стоит строить планы.

Часто задаваемые вопросы

В: Что такое дезагрегированный LLM serving и почему это важно?

Дезагрегированный serving разделяет две фазы инференса LLM — prefill (обработка входного промпта) и decode (генерация токенов) — на отдельное железо, оптимизированное под каждую. Prefill ограничен вычислениями, decode — пропускной способностью памяти, поэтому запуск обоих на одном GPU расточителен. Разделение позволяет независимо масштабировать каждый флот и использовать более дешёвый кремний для prefill.

В: Означает ли это, что Tenstorrent сравнялся с флагманами NVIDIA H100 или H200?

Нет. Заявление Moreh — о соответствии или превосходстве над производительностью DGX A100-класса, то есть предыдущего поколения рабочих лошадок NVIDIA, а не текущего фронтира H100/H200. Питч — это экономически эффективный паритет на корпоративном инференс-уровне, а не вытеснение топового обучающего кремния.

В: Могут ли команды использовать MoAI Inference Framework сегодня на смешанном железе?

По данным Moreh, MoAI поддерживает единую эксплуатацию процессоров NVIDIA, AMD и Tenstorrent в одном кластере, а компания является стратегическим партнёром Tenstorrent и крупным контрибьютором Metalium. Производственная готовность на Tenstorrent была подтверждена на TT-Deploy 1 мая 2026 года, поэтому сроки внедрения для сторонних команд будут зависеть от прямого взаимодействия с Moreh.

История Claude Code, которую мы пока не можем проверить

Единственный доступный источник этой истории о Claude Code — страница верификации браузера без единого факта. Вот что само это отсутствие говорит покупателям ИИ-инструментов.

История доходов Anthropic против OpenAI: что мы пока не можем проверить

Заголовок о том, что Anthropic обогнала OpenAI по доле рынка LLM, распространяется в сети, но первоисточник закрыт за проверкой браузера. Вот что это означает.

X перестраивает рекламный стек на xAI: цель $2,46 млрд к 2026 году

X выпустила обновлённую рекламную платформу на моделях ранжирования xAI, преследуя прогноз eMarketer в $2,46 млрд на 2026 год — рост на 8,8% к 2025 году на рынке, где доминируют Google и Meta.