Moreh досягає показників A100 на Tenstorrent без надбавки за HBM

Уявіть вантажний двір, де всі контейнери десятиліттями рухаються одним і тим самим рейковим шляхом. І раптом хтось прокладає другу колію — вужчу, дешевшу — і зазначає, що половині вантажу насправді не потрібен експрес-маршрут. Приблизно це й зробила компанія Moreh на сцені в Сан-Франциско. Тільки замість вантажу — токени LLM, а замість експресу — GPU, набиті HBM-пам'яттю.

Що сталося

1 травня на заході TT-Deploy від Tenstorrent у Сан-Франциско компанія Moreh із Санта-Клари вийшла на сцену та запустила живе демо LLM inference на системі Tenstorrent Galaxy Wormhole. Як повідомило видання 巴士的報 наступного дня, компанія заявила, що показники inference на Galaxy Wormhole відповідають або перевершують системи класу NVIDIA DGX A100 для цілого набору моделей Mixture-of-Experts: GPT-OSS, Qwen, GLM та DeepSeek.

Валідацію забезпечив власний MoAI Inference Framework від Moreh. Головна ідея — архітектурна, а не кременева: розподілена схема обслуговування, яка поєднує GPU з чипами Tenstorrent Wormhole, використовуючи процесори Tenstorrent як виділені прискорювачі prefill. Decode залишається на GPU. Prefill з них переноситься. Результат, за словами Moreh, — суттєве зниження залежності від дорогої HBM і менший загальний рахунок за інфраструктуру.

Генеральний директор Gangwon Jo охарактеризував це як важливий етап. «Досягнення виробничого рівня продуктивності та стабільності LLM inference на системах на базі Tenstorrent є значною віхою», — сказав він, додавши, що команда «продовжуватиме підвищувати продуктивність завдяки глибшій оптимізації в гетерогенних архітектурах та тіснішій інтеграції з NPU від Tenstorrent».

Важливий контекст: Moreh є стратегічним партнером Tenstorrent і одним із найбільших зовнішніх контрибуторів до Metalium — низькорівневого програмного стеку Tenstorrent. Компанія вже працює з виробничими середовищами на базі AMD GPU у реальних дата-центрах, має дочірню структуру з розробки базових моделей Motif Technologies та співпрацює з AMD, Tenstorrent і SGLang. Жодна з цих деталей не є випадковою. Виробничих показників на новому залізі не досягають без багаторічного досвіду чужого налагодження, вбудованого у ваш runtime.

Технічна анатомія

Щоб зрозуміти, чому це важливо, потрібно розібратися, що LLM насправді робить під час обробки запиту. Є дві фази, і вони такі ж несхожі між собою, як спринтер і марафонець. Prefill паралельно обробляє весь вхідний промпт: обчислювально навантажена, надзвичайно паралельна, вимоглива до FLOPs. Decode генерує токени один за одним — авторегресивно, чутливо до затримки, з вузьким місцем у вигляді пропускної спроможності пам'яті, — саме тому й існує HBM.

Стандартна відповідь галузі: завантажити обидві фази на один GPU і сподіватися, що стратегія батчингу приховає невідповідність. Кожен, хто налаштовував розгортання vLLM о другій ночі, знає нудну частину: стрибки prefill руйнують хвостову затримку, а HBM простоює під час довгих хвостів decode. Ви платите преміум за пам'ять, щоб виконувати обчислювальну роботу.

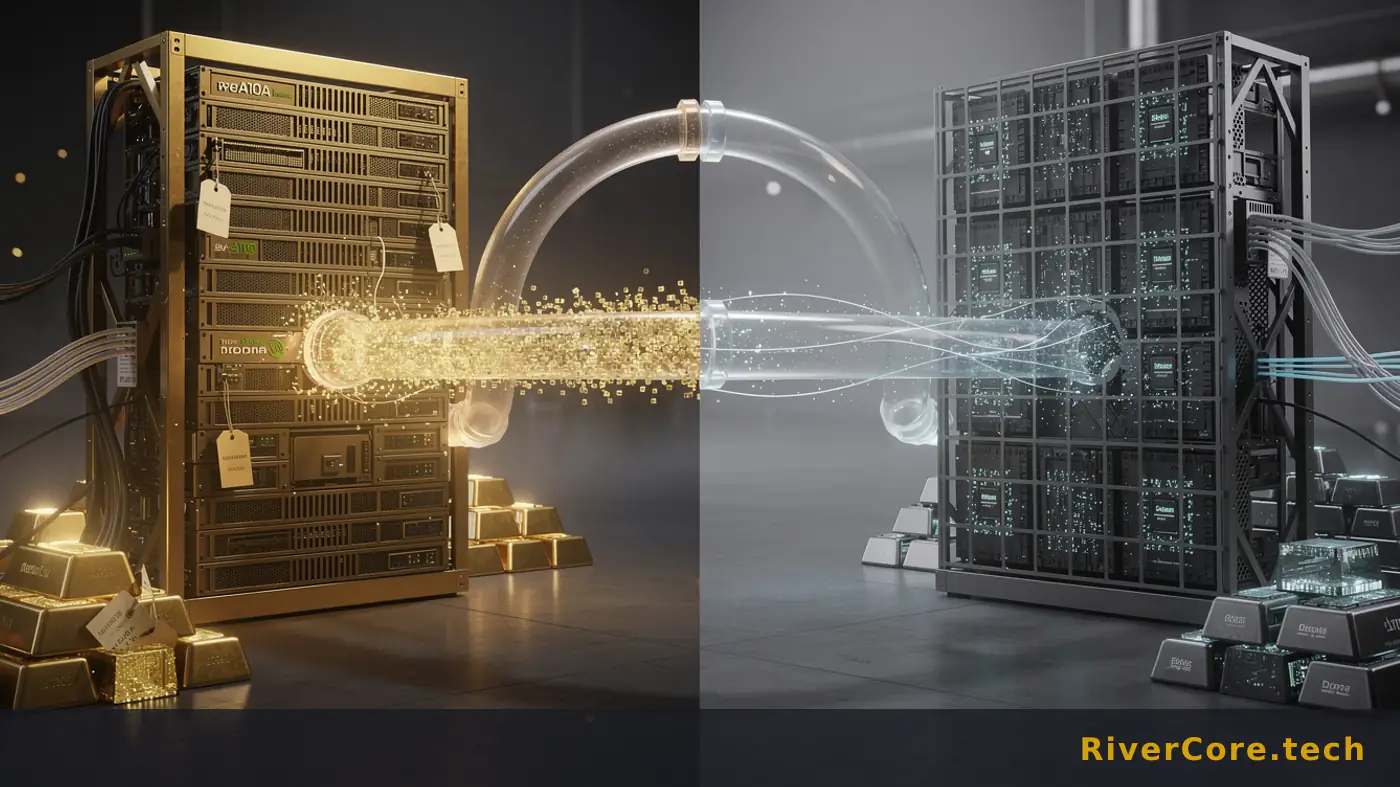

Розподілене обслуговування розділяє ці дві фази. Відправте prefill на вузол, оптимізований для обчислювальної пропускної спроможності, передайте KV cache на вузол decode, оптимізований для пропускної спроможності пам'яті, і нехай кожен робить те, що вміє. Splitwise та DistServe довели академічний кейс. Внесок Moreh — це виробничі з'єднання на гетерогенному залізі: prefill на Tenstorrent Wormhole, decode на GPU, все оркеструється MoAI як єдиний кластер.

Архітектура Wormhole ідеально підходить для цієї ніші. Чип спирається на SRAM-насичену тайлову архітектуру, а не на стеки HBM — саме те, що потрібно, коли ваша задача — dense matmul на відомому промпті без необхідності стрімінгу великого KV cache. Використайте його як прискорювач prefill, і рахунок за HBM — частина, де все фінансово розвалюється, — падає, бо ви розмірюєте HBM тільки під decode-флот.

Деталі щодо MoE також мають значення. GPT-OSS, Qwen, GLM та DeepSeek маршрутизують токени до підмножин експертів, що додає накладні витрати на комунікацію, але зменшує обчислення на токен. Правильно реалізувати MoE на бекенді не від NVIDIA означає обробляти all-to-all маршрутизацію через фабрику, яку не проектували для NCCL. Ось у чому суть, і саме тут окупається внесок у відкриті inference-стеки на кшталт SGLang.

Хто постраждає

Монокультура NVIDIA — очевидна відповідь, але реальна вразливість цікавіша. Компанії, яким варто хвилюватися, — це провайдери inference-as-a-service, які закладали свою маржу, виходячи з припущення, що флоти DGX-класу H100/H200 є єдиним шляхом до виробничої якості затримки. Якщо корейська software-компанія може досягти показників класу A100 на дешевшому залізі завдяки розумній топології запитів, ґрунт під преміум-орендою GPU починає зсуватися.

Клас A100 — це не клас H200, і я б сказав, що Moreh свідомо обережний у цьому порівнянні. Пітч не «ми перемогли фронтир». Пітч — «ми досягаємо робочого рівня за меншою вартістю матеріалів». Для 80% корпоративних inference-навантажень (RAG-ендпоінти, внутрішні copilot, пакетне резюмування) пропускна спроможність рівня A100 за нижчою вартістю і є реальним ринком.

Наступні 90 днів виглядають болісно для двох конкретних груп. По-перше, стартапи GPU-хмар з єдиним постачальником, чия єдина перевага — «у нас є квота». Якщо гетерогенні кластери стануть доступними для замовлення, квота перестає бути конкурентною перевагою. По-друге, команди інфраструктури в AI-компаніях середнього рівня, які будували свій стек з розрахунком на CUDA назавжди. Їхні CTO почнуть отримувати від ради директорів запитання про диверсифікацію заліза, і відповідь «ми працюємо тільки на NVIDIA» стає дедалі важчою для захисту.

Tenstorrent отримує реальний виробничий референс. До цього пітч був потенційним. TT-Deploy з живим демо від партнера, який виконує реальні MoE-навантаження, — перший раз, коли компанії є на що вказати окрім бенчмарків. AMD теж виходить добре: фреймворк Moreh підтримує AMD GPU в тому самому кластері, а отже, залізо класу MI300 тепер має надійного inference-партнера, який не намагається переманити їх до NVIDIA.

Практичні кроки для AI-розробки

Якщо ви запускаєте inference у будь-якому значущому масштабі, домашнє завдання цього тижня просте. Проаудіюйте своє співвідношення prefill до decode. Якщо ви не знаєте, яка частка ваших GPU-секунд витрачається на prefill, а яка на decode, ви не можете міркувати про розподіл, і майже напевно переплачуєте за HBM. Більшість команд виявляють, що prefill становить 30–50% обчислень на навантаженнях із довгим контекстом — і це та частка, яку можна перенести з преміум-заліза.

По-друге, перестаньте сприймати прив'язку до постачальника як теоретичну проблему. MoAI Inference Framework підтримує NVIDIA, AMD та Tenstorrent в єдиному кластері. Незалежно від того, чи ви впроваджуєте Moreh, проектуйте свій сервісний шар так, щоб заміна бекенду була зміною конфігурації, а не переписуванням коду. SGLang та подібні runtime дають вам розумну абстракцію. Використовуйте її.

По-третє, якщо ви будуєте агентний продукт, подивіться, де prefill домінує у вашому рахунку. Агенти з викликом інструментів, які re-prefill довгі контекстні вікна на кожному кроці, — найгірший кейс для монолітного GPU-обслуговування. Патерни, задокументовані в документації Anthropic щодо кешування промптів і використання інструментів, допомагають лише до певної межі. Структурне рішення — розподіл, і тепер його можна купити.

По-четверте, поговоріть із відділом закупівель. Терміни постачання систем Tenstorrent Galaxy — не те саме, що терміни на H200. Якщо ваш план потужностей на 2026 рік — «чекати на квоту від NVIDIA», тепер існує реальний паралельний шлях. Прорахуйте цифри для змішаного кластера до наступного бюджетного циклу.

Ключові висновки

- MoAI Inference Framework від Moreh досяг показників класу DGX A100 на Tenstorrent Galaxy Wormhole для моделей GPT-OSS, Qwen, GLM та DeepSeek MoE — підтверджено наживо на TT-Deploy 1 травня.

- Архітектура переносить prefill на Tenstorrent і залишає decode на GPU, знижуючи залежність від HBM та загальну вартість інфраструктури.

- MoAI запускає залізо NVIDIA, AMD та Tenstorrent в єдиному кластері — перша виробнича відповідь на прив'язку до постачальника, яку я бачив задемонстрованою в реальності, а не на слайдах.

- Ризику зазнають GPU-хмари з єдиним постачальником та inference-стеки тільки на CUDA, а не фронтирне залізо NVIDIA, яке залишається поза конкуренцією на верхньому рівні.

- Проаудіюйте розподіл prefill і decode цього тижня та спроектуйте свій сервісний шар так, щоб заміна бекенду була на рівні конфігурації, а не архітектури.

Повернімося до вантажного двору. Експрес-маршрут досі працює, H200 нікуди не зникають, і фронтирне навчання залишається CUDA-історією в осяжному майбутньому. Але друга колія відкрита для бізнесу, і вантаж, якому не потрібен експрес, щойно отримав дешевшу альтернативу. Саме це гіперскейлери помітять першими, і саме навколо цього решті з нас варто будувати плани.

Часті запитання

Q: Що таке розподілене обслуговування LLM і чому це важливо?

Розподілене обслуговування розділяє дві фази LLM inference — prefill (обробка вхідного промпту) і decode (генерація токенів) — на окреме залізо, оптимізоване для кожної з них. Prefill обмежений обчисленнями, decode — пропускною спроможністю пам'яті, тому запуск обох на одному GPU марнує ресурси. Розподіл дозволяє незалежно масштабувати кожен флот і використовувати дешевше залізо для prefill.

Q: Чи означає це, що Tenstorrent відповідає флагманським чипам NVIDIA H100 або H200?

Ні. Заява Moreh стосується відповідності або перевершення продуктивності класу DGX A100 — попереднього покоління робочих чипів NVIDIA, а не поточного фронтиру H100/H200. Пітч — ефективний за вартістю паритет на рівні корпоративного inference, а не витіснення топового навчального заліза.

Q: Чи можуть команди вже сьогодні використовувати MoAI Inference Framework на змішаному залізі?

За словами Moreh, MoAI підтримує уніфіковану роботу процесорів NVIDIA, AMD та Tenstorrent в єдиному кластері, а компанія є стратегічним партнером Tenstorrent та одним із найбільших контрибуторів до Metalium. Готовність до виробництва на Tenstorrent була щойно підтверджена на TT-Deploy 1 травня 2026 року, тому терміни впровадження для сторонніх команд залежатимуть від прямої взаємодії з Moreh.

Історія Claude Code, яку ми поки що не можемо перевірити

Єдине доступне джерело про Claude Code — це сторінка перевірки браузера без жодних фактів. Ось що ця відсутність говорить покупцям AI-інструментів.

Заяви про доходи Anthropic проти OpenAI, які ми поки що не можемо перевірити

Заголовок про те, що Anthropic обігнав OpenAI за часткою доходів LLM, поширюється мережею, але першоджерело зараз заблоковане браузерною перевіркою. Ось що це означає.

X Перебудовує Рекламний Стек на xAI: Ціль $2,46 млрд на 2026 рік

X запустила оновлену рекламну платформу на моделях xAI, орієнтуючись на прогноз eMarketer у $2,46 млрд на 2026 рік — зростання на 8,8% порівняно з 2025 роком на ринку, де домінують Google і Meta.